MIT研究團隊開發革命性AI視覺系統 讓救災機器人在坍塌礦坑中快速建立3D環境地圖 同時實現即時定位導航的生死任務 最新技術突破將登上國際頂尖AI會議發表

當礦坑發生坍塌事故,救災機器人深入險境搜尋受困者時,必須在分秒必爭的狀況下即時生成現場3D地圖並精準定位。傳統系統每秒僅能處理約60張影像,但在真實災害現場,機器人需要快速穿越複雜地形並消化數千張影像才能完成任務。

MIT科學家從經典電腦視覺技術獲取靈感,結合最新人工智慧模型,打造出能增量生成場景地圖的創新系統。這套方案會先建立多個局部子地圖,再用獨家演算法將這些「數位拼圖」無縫接合成完整3D地圖,同時計算機器人即時位置。

最突破性的進展在於: ✓ 不需預先校正鏡頭參數 ✓ 免除專家手動調校系統 ✓ 重建速度提升400% ✓ 平均誤差小於5公分

「我們在系統中設計了數學變形補償機制,」研究團隊解釋:「當子地圖出現牆面彎曲或拉伸等數位形變時,採用彈性對齊演算法來確保拼接準確度。」這項突破成功克服機器學習模型常見的影像處理模糊問題。

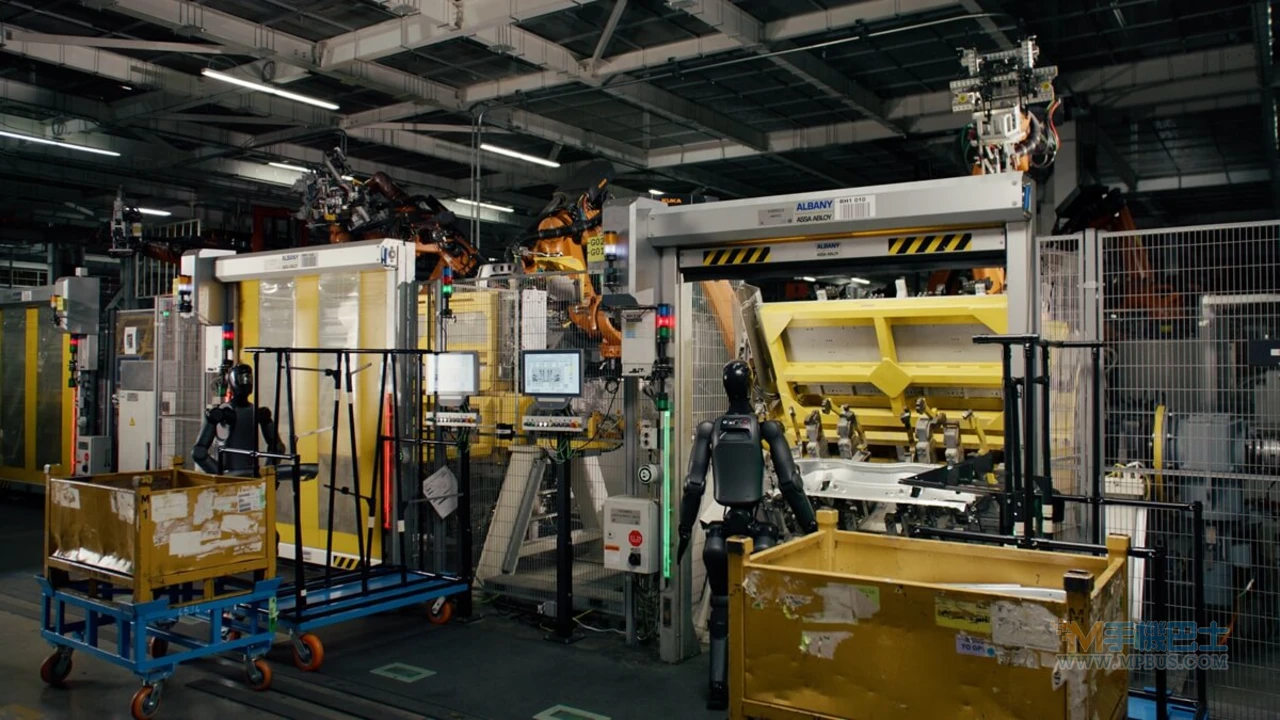

實測顯示,這項技術僅需手機拍攝的短影片,就能在數秒內重建出MIT教堂內部結構。除了搜救應用,未來更可延伸至: ✓ VR頭戴裝置的擴增實境體驗 ✓ 倉儲物流機器人的貨品定位 ✓ 工業自動化巡檢系統

「當你深刻理解幾何原理的本質,就能創造出更具擴展性的解決方案。」主導研究的教授強調。團隊現正優化系統在極端環境的穩定性,預計2026年進行實際救災場域測試。這項由美國國家科學基金會等單位支持的研究,即將在NeurIPS國際AI頂會正式發表。

手機巴士

手機巴士